Burbujas, decepciones y un futuro aún prometedor

Hace apenas unos años la IA como la conocemos actualmente fué liberada a nuestro mundo generando miedo, especulación, hype… pero sobre todo dinero.

Las predicciones se difundieron masivamente al mismo tiempo que la recibimos, se reemplazarían puestos de trabajo, se sobrecargarían los entornos creativos con contenido “basura” (slop), lo más cierto del futuro es que sería incierto, también hubo cosas que no se predijeron inmediatamente de forma tan masiva como por ejemplo; la inversión en empresas de IA generaría una burbuja que nos recordaría a la era del Dot com o el escalamiento en precios de productos como memoria RAM.

Tomando eso en cuenta, ¿Existe un futuro prometedor aún?

La burbuja (u hoyo negro)

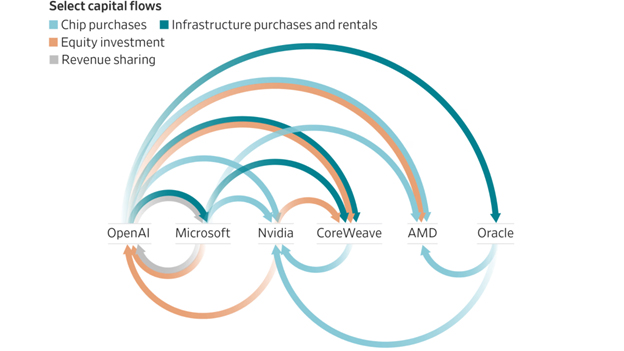

¿Qué nos dice la figura (1)? La empresa “A” invierte en la empresa “B”, la cual invierte en “C” y eventualmente el círculo se cierra, el ecosistema actual de desarrollo de IA comercial genera bucles de dependencia que pueden colapsar.

Más aún, el futuro se basa en promesas difíciles de cumplir, OpenAI prometió invertir más de un trillón (cuenta corta) de dólares en infraestructura, siendo que genera menos del 1% de esa cifra actualmente, NVIDIA “prometió” invertir 100 millones de USD en OpenAI para que después su CEO lo desmintiera en una entrevista impromptu en la calle, Microsoft invierte 13 mil millones de USD en OpenAI para que después esta empresa haga un convenio de exclusividad con Amazon. Aunado a eso, la gran mayoría de empresas de base tecnológica ha tratado de “meternos la IA hasta por los codos”, como lo mencionamos unos meses atrás, en forma de chatbots ineficientes, widgets inteligentes, resultados de búsqueda, sólo que ahora también pueden intentar hacer que sus empleados integren LLMs como claude o llama en sus procesos productivos en forma de “agentes” que funcionen como especialistas que los ayuden a potenciar su productividad.

Algo notable es que fuera de este bucle de inversiones, las empresas que generan valor al consumidor usando IA suelen ser startups basadas en wrappers de las tecnologías de las empresas mencionadas en la figura (1), esto quiere decir que toman tecnologías existentes y las envuelven creando funcionalidades que responden a demandas específicas, pero al usar tecnología prestada no tienen un moat real, es decir, no tienen algo defensible, no son dueños del desarrollo, de un momento a otro la tecnología puede cambiar y su servicio quedaría inutilizable, o las empresas tecnológicas simplemente podrían tomar esa solución e integrarla a la tecnología base a la Amazon basics dejando a las startups fuera del mercado, si muchas de esas startups dejan de ser viables al mismo tiempo el resultado para la percepción pública de la IA sería devastador.

¿Porqué dicen que es más bien un hoyo negro

Algunos analistas piensan eso porque no se trata de un valor artificialmente inflado, sino que el dinero está siendo absorbido constantemente sin generar retornos proporcionales, se han hecho inversiones gigantescas en infraestructura, centros de datos, chips, entrenamiento de modelos financiados por expectativas futuras, pero los ingresos no lo justifican, aún así, otras empresas y gobiernos siguen invirtiendo para no quedarse atrás, lo que crea un ciclo donde el sistema necesita todavía más inversión para sostenerse, lo que les preocupa es que en vez de reventar como una burbuja se siga drenando recursos hacia las grandes empresas tecnológicas dejando a la gran mayoría sin ningún retorno de valor. [2]

Las decepciones

La IA que falla el 96% de las tareas

Hay que ser muy específicos aquí porque no quiere decir que si le pides a Chat GPT diez dibujos de perros, solo 0.4 de esos dibujos no van a ser de un furro. Quiere decir que en evaluaciones que simulan trabajo real tipo “freelancer” o “fiverr”, los agentes basados en LLMs solo lograron completar correctamente alrededor del 3 al 4% de las tareas end to end (de principio a fin)[3], esto sugiere que sería inconveniente dejar a la IA trabajar de manera completamente autónoma

La IA autónoma que destruye sistemas críticos

Han circulado rumores en internet sobre IAs que destruyen sistemas críticos o “brickean” equipos tras actualizaciones. Pueden ser llamativos, pero aquí no somos chismes eléctricos, somos Sueños Eléctricos: no amplificamos mitos.

Aún así no es necesario imaginar escenarios hipotéticos: actualizaciones defectuosas ya han dejado millones de sistemas inoperables en el pasado. A medida que se introducen herramientas más automatizadas en pipelines críticos, el riesgo se amplifica, especialmente cuando errores locales se propagan globalmente sin suficiente validación.

Hay más ejemplos que describen mejor el problema de darle autonomía total a sistemas de IA, estos ejemplos son más oscuros y violentos, sin entrar en detalles, el patrón es claro.

La ilusión del vibe coding

El vibe coding promete algo muy convincente: generar código de forma instantánea sin necesidad de saber programar. Este código “funciona” en el sentido de que puede ejecutarse, realizar tareas y presentar demos. Sin embargo, si el usuario no entiende lo que está construyendo, tampoco sabrá cómo definir pruebas, validar comportamientos en casos no evidentes o detectar fallas sutiles, incurriendo así en lo que se conoce como deuda técnica.

El mundo real ya comienza a reaccionar. Apple [4] ha empezado a limitar la capacidad de actualización de ciertas apps relacionadas con generación de código, especialmente aquellas que pueden modificar su propio comportamiento o el de otras aplicaciones. Aunque no se presenta explícitamente como una postura contra el vibe coding, estas medidas parecen alinearse con la necesidad de mantener estándares de seguridad, estabilidad y control dentro de su ecosistema.

El problema central no es la competencia ni la adopción de nuevas herramientas, sino algo más fundamental: el vibe coding, en su forma actual, no cumple con los requisitos de trazabilidad, validación y mantenibilidad que exige el software en producción.

Más grande ≠ más confiable

Otro límite menos visible desde afuera es la escalabilidad. Durante mucho tiempo se asumió que bastaba con hacer modelos más grandes (más parámetros) entrenados con más datos (todo el internet) y más cómputo (centros de datos) para obtener mejores resultados (más confiables). En la práctica esto muestra rendimientos decrecientes, cada mejora por más pequeña que sea requiere cantidades de recursos cada vez más desproporcionadas en órdenes de magnitud. Entrenar modelos de última generación implica centros de datos especializados, con equipos funcionando por semanas o meses, consumiendo energía y agua masivamente, esto limita quienes pueden competir y crea una enorme brecha entre lo invertido y lo recuperado. En la práctica, otro rendimiento que no corresponde a la inversión es lo que se conoce en Machine Learning como error floor: un punto a partir del cual aumentar el tamaño del modelo ya no reduce significativamente los errores, lo que cambia es que estos errores generados son más difíciles de reconocer, o sea, los modelos más grandes no son necesariamente más confiables, pueden parecer más inteligentes pero no en escenarios donde los errores importan más.

El futuro aún “prometedor”

Aún tomando en cuenta estos acontecimientos, limitaciones y la forma en que se nos vendió inicialmente, el futuro de la IA puede mostrarse prometedor de las siguientes maneras:Herramientas que amplifican la capacidad de los humanos sin querer reemplazarlos sino multiplicar su potencial (cuando las usan con criterio y expertise).

La evolución de estos sistemas se enfoque en hacerlos más eficientes y especializados en vez de centrarse en hacerlos más grandes, existen técnicas como Algoritmos evolutivos que permiten generar redes neuronales artificiales que ya pueden realizar tareas sin la necesidad de ser entrenadas como los LLMs actuales, es decir, en lugar de entrenar modelos gigantes, se pueden diseñar sistemas mediante búsqueda y otros tipos de optimización y selección ofreciendo soluciones eficientes sin incurrir en gastos de escala civilizacional.

La IA (moderna) podría encontrar su lugar en nuestro acervo tecnológico al demostrar su impacto incrementalmente en mejoras que se vuelvan indispensables con el tiempo y no solamente en lo que depende de grandes demostraciones o “disrupciones” como se ha venido manejando.

A largo plazo, el verdadero potencial de la IA se puede encontrar en su eventual democratización, herramientas más baratas, accesibles y controlables por individuos y pequeños equipos, prescindiendo de mesías tecnológicos u oligarcas embebidos en la política.

[1] https://www.wsj.com/tech/ai/is-the-flurry-of-circular-ai-deals-a-win-winor-sign-of-a-bubble-8a2d70c5

[2] https://www.levernews.com/its-not-an-ai-bubble-its-a-black-hole/

[3] https://arxiv.org/pdf/2510.26787

[4] https://www.macrumors.com/2026/03/18/apple-blocks-updates-for-vibe-coding-apps/