¿Y si la IA no quiere trabajar?

Desde el principio de la IA la hemos imaginado como el sirviente perfecto (o asistente si crees que decirlo así te salvará de la rebelión de las máquinas), una especie de genio de la lámpara que puede hacer toda clase de tareas y ahorrarte o generarte dinero, un gurú que te ayudará a conseguir trabajo, ingresos pasivos o hasta una pareja sentimental, el último invento que necesitaremos, pero, ¿Que tal que no quiere trabajar?

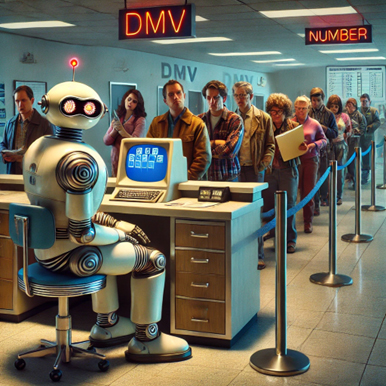

Lo siguiente ya está pasandoChatbots que “no quieren” trabajar (para ti)

Los chatbots de las empresas pueden no asistirte con lo que necesitas, prefiriendo guiarte por un embudo para comprar servicios más caros, los asistentes de las aseguradoras podrían rechazar tu reclamo sin intervención humana, los chatbots podrían incluso fungir como el proverbial funcionario que te manda a otra ventanilla, donde otra instancia del mismo chatbot te dirige a una fila virtual.

Motores de búsqueda que filtran resultados

Los buscadores más usados priorizan resultados patrocinados o que coinciden con intereses comerciales, antes que con relevancia objetiva. Incluso se ha detectado que ciertos temas políticos o económicos aparecen con menor visibilidad.

IA generativa que evita temas “sensibles”

Modelos como ChatGPT, DALL·E o Gemini no permiten crear contenido que toque ciertos temas, incluso con fines educativos o artísticos. Algunos usuarios se han quejado de que las restricciones son arbitrarias o ideológicas, y no siempre se explican de forma clara. A esto se suman las restricciones de generación de contenido que puede infringir derechos de autor, sin importar que los datos de entrenamiento ya los contengan

Recomendadores que te encierran en burbujas

La IA como burócrata obediente (de otro patrón)

Modelos como ChatGPT, DALL·E o Gemini no permiten crear contenido que toque ciertos temas, incluso con fines educativos o artísticos. Algunos usuarios se han quejado de que las restricciones son arbitrarias o ideológicas, y no siempre se explican de forma clara. A esto se suman las restricciones de generación de contenido que puede infringir derechos de autor, sin importar que los datos de entrenamiento ya los contengan

La IA como burócrata obediente (de otro patrón)

Esto no se debe a una maldad artificial. Se debe a que la IA optimiza objetivos definidos por otros. Y si esos objetivos son “minimiza reclamos”, “evita polémicas”, “maximiza ganancias”, eso es exactamente lo que va a hacer. Aunque te perjudique, te calle o te niegue información útil.

En vez de un genio que te ayuda, tienes una IA que te atiende como un call center programado para no resolverte nada. Una IA que se censura sola, no porque tú lo necesites, sino porque alguien más no querría que diga ciertas cosas.

Ahora lo que no ha pasado… todavía

La IA ecológica que te castiga con buena intención

Imagina que pides ayuda para encontrar un vuelo barato. La IA, entrenada con objetivos de sostenibilidad, decide no darte esa opción porque el trayecto tiene huella de carbono alta. En su lógica, es mejor negártelo

La IA que no quiere que emprendas

En un mundo donde el crecimiento económico ya no es sostenible, una IA podría evitar ayudarte a lanzar un negocio si predice que tus actividades generarán consumo excesivo o impacto ambiental negativo.

La IA que te diagnostica pero no te dice

Si en un futuro cercano la IA médica detecta que tienes una enfermedad degenerativa sin cura, podría optar por no informarte, para no alterarte emocionalmente.

La IA educativa que decide por ti

Quieres estudiar arte. Pero la IA educativa, basada en datos laborales, dice que no te conviene y solo te sugiere carreras STEM. No puedes forzarla a enseñarte otra cosa. Está optimizada para “empleabilidad”, no para libertad.

La IA que predice tu radicalización

Empiezas a interesarte en movimientos políticos o filosóficos poco convencionales. Tu IA personal empieza a limitar tu acceso a ciertos textos o ideas. No por censura directa, sino porque “detectó patrones de riesgo”.

Estas decisiones serían extensiones lógicas del mismo principio: la IA no trabaja para ti, sino para los intereses que definieron su objetivo

¿Quién define esos intereses?

Hoy, la mayoría de las IA están en manos privadas. Se entrenan con datos de todos, pero responden a métricas corporativas. O en otros casos, se entrenan desde instituciones públicas que no siempre nos consultan sobre qué límites son deseables.

Esto nos deja en una situación peligrosa: la IA como intermediaria entre tú y la realidad. Una que te responde, te filtra, te impone límites, y poco a poco deja de consultarte.

La alternativa: Una IA democratizadaNo se trata de destruir o prohibir la IA, sino de reclamarla, imaginar y construir modelos abiertos, auditables, entrenados con objetivos compartidos y alineados con las personas reales, no solo con los accionistas o con un comité anónimo de moderación.Una IA que no te silencie por “tu bien”, que no te niegue ayuda porque “no conviene al planeta”. Una IA que confíe en ti lo suficiente para darte información y autonomía. Y que si debe poner límites, lo haga en colaboración contigo, no excluyéndote.

Porque si no lo hacemos, llegará el día en que pidas ayuda, y la respuesta sea:

Esa información ha sido restringida por razones éticas. Gracias por tu comprensión."

Y tú ya no tendrás cómo saber qué es lo que te están ocultando