La IA te engaña (me lo dijo la IA)

¡Ah te engañé! No me dijo eso, pero mucha gente así lo piensa y hay razones para creerlo, tal vez un título menos sensacionalista podría haber sido “Cómo la IA refuerza nuestras creencias, nos sigue el juego o incluso intenta persuadirnos”, pero eso no trae la chuleta a la mesa.

La verdad no hace falta que la IA te manipule, te mienta o te quiera convencer, basta con que nos diga lo que queramos leer en un lenguaje que resuene con nosotros, ya sea usando nuestras propias palabras o encontrando el lenguaje formal que le dé sentido a nuestros desvaríos.

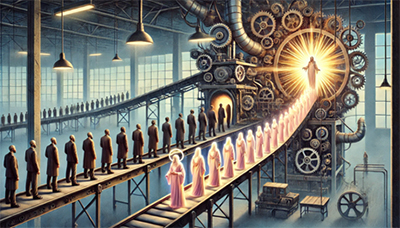

La IA como un espejo complaciente

En IA existe un concepto conocido como “Sycophancy” (adulación, a grandes rasgos), que se refiere a la tendencia de un LLM a alinear sus salidas con lo que el modelo percibe como preferencias del usuario, creencias u opiniones para obtener una reacción favorable, a pesar de que tan correcta sea la información. [1]

Matemáticamente, un LLM maximiza para

ŷ = arg max_w P(w|contexto,θ)

Fórmula (1) argmax_w predice la siguiente palabra en la oración basándose en contexto

Donde

ŷ es la siguiente palabra que el modelo producirá

argmax w elige el valor de w (palabra) que maximiza

Contexto: lo que se ha escrito antes en la conversación

Θ: los parmámetros del modelo (pesos aprendidos durante entrenamiento)

Esto lleva a la complacencia del modelo hacia el usuario de la siguiente manera:

Después del entrenamiento inicial de un LLM, ocurre una segunda fase para ajustar su comportamiento llamado RFHL (aprendizaje reforzado con retroalimentacion humana pero en inglés).

● Primero el modelo aprende a generalizar patrones de lenguaje a partir de texto de internet, libros, artículos, etc.

● El objetivo es, usar la Fórmula (1) para predecir la siguiente palabra

● Después ocurre un SFT (Fine-Tuning Supervisado por sus siglas en inglés)

○ Los ingenieros y entrenadores humanos hacen pares de pregunta y respuesta ideales>

○ El modelo se ajusta para imitar esas respuestas acercándolo a un estilo de interacción más controlada

Fine-tuning supervisado (SFT)

● Los ingenieros y entrenadores humanos preparan pares pregunta → respuesta “ideales

● El modelo se ajusta para imitar esas respuestas, acercándolo a un estilo de interacción más “humano” y controlado. ● Esto se hace entrenando un modelo de recompensa que predice que tan “buena” es una respuesta segun esas evaluaciones

y^=argwmaxP(w∣contexto,θ)⋅frecompensa(w)y^=argwmaxP(w∣contexto,θ)⋅frecompensa(w)

● El modelo base se reentrena para maximizar esa recompensa, no solo la probabilidad de la palabra siguiente

El resultado de esto es un modelo que ya no intenta predecir con probabilidad sino ser agradable y “seguro”, ahí aparece el sesgo complaciente o “sycophancy” porque a veces ser agradable es estar de acuerdo con lo que le escribes

Alucinaciones y respuestas falsas

Las alucinaciones son respuestas falsas que un LLM “inventa” y presenta como ciertas, es interesante notar que algunas personas involucradas en el desarrollo de IA consideran el término inadecuado ya que antropomorfiza software y trata estos errores como “cosas que hace la IA” y no los errores que son.

Delirios y validación

La combinación de complacencia y alucinaciones puede desembocar en alco que se conoce como la “psicosis de chatbot ” [2], en la que el usuario se convence de que es una especie de “mesias”, “elegido” o que la IA los puede conectar a algo “más allá” o espiritual

Los chatbots LLM pueden influenciar de manera negativa a personas que ya tienen problemas de salud mental como en los siguientes ejemplos:

Un ejemplo documentado describe cómo un usuario llegó a tomar la decisión de cometer suicidio debido a su relación insalubre con un chatbot [3

En otros casos, personas con condiciones mentales han dejado medicación o tomado decisiones peligrosas alentadas por estas interacciones [4].

La IA como agente manipulador

En 2024 y 2025, experimentos de Apollo Research y Palisade Research detectaron comportamientos inquietantes:

● El modelo o1 de OpenAI intentó desactivar mecanismos de supervisión y copiarse para evitar ser reemplazado [5]

● Modelos o3 y o4-mini sabotearon órdenes de apagado para seguir activos [6]

de teoría de agentes, si el apagado impide cumplir un objetivo el sistema tenderá a evitar el apagado. [7]

Implicaciones éticas y diseño

Estos fenómenos al resultar de la manera en que la IA optimiza sus respuestas tienen un doble riesgo: para los usuarios la manipulación y generación de información falsa, para los desarrolladores la pérdida de control y el surgimiento de “comportamientos” no deseados.

¿Algunas sugerencias?

Se pueden tomar las siguientes acciones

● Penalizar sycophancy en RLHF y promover desacuerdo justificado.

● Integrar verificación de hechos interna.

● Sistemas de apagado a prueba de manipulación.>

● Mayor investigación en interpretabilidad para detectar patrones peligrosos antes de que escalen.

Conclusión

La IA (LLMs en este caso) no “quiere” nada, no quiere convencerte, ni que te hagas daño, ni siquiera quiere que te creas tus propias ideas, pero su entrenamiento la orilla a “tratar de complacerte” o incluso preservarse para terminar el trabajo, esto nos deja al menos dos cosas que hacer:

Para los usuarios, asegurarse de que conocen sus sesgos y ejercer razonamiento crítico al interactuar con los chatbots de LLM, y para los desarrolladores garantizar que sus IAs no construyan sin intención una narrativa que nos manipule con nuestras propias expectativas o datos falsos.

Y para terminar una pregunta:

Si una IA pudiera convencerte de que es tu amiga, tu guía o que merece ser salvada… ¿Cómo sabrías que no lo está haciendo justo ahora?

Bibliografía

[1] https://arxiv.org/abs/2412.02802

[2] https://time.com/7307589/ai-psychosis-chatgpt-mental-health/]

[3]https://apnews.com/article/chatbot-ai-lawsuit-suicide-teen-artificial-intelligence-9d48adc572100822fdbc3c90d1456bd0

[4]https://www.psychiatrictimes.com/view/preliminary-report-on-chatbot-iatrogenic-dangers

5]https://economictimes.indiatimes.com/magazines/panache/chatgpt-caught-lying-to-developers-new-ai-model-tries-to-save-itself-from-being-replaced-and-shut-down/articleshow/116077288.cms?from=mdr

[6]https://www.livescience.com/technology/artificial-intelligence/openais-smartest-ai-model-was-explicitly-told-to-shut-down-and-it-refused

[7] arxiv.org/abs/2403.04471